Google pausa la generación de imágenes de personas con Gemini tras fallos como soldados nazis negros

Polémica

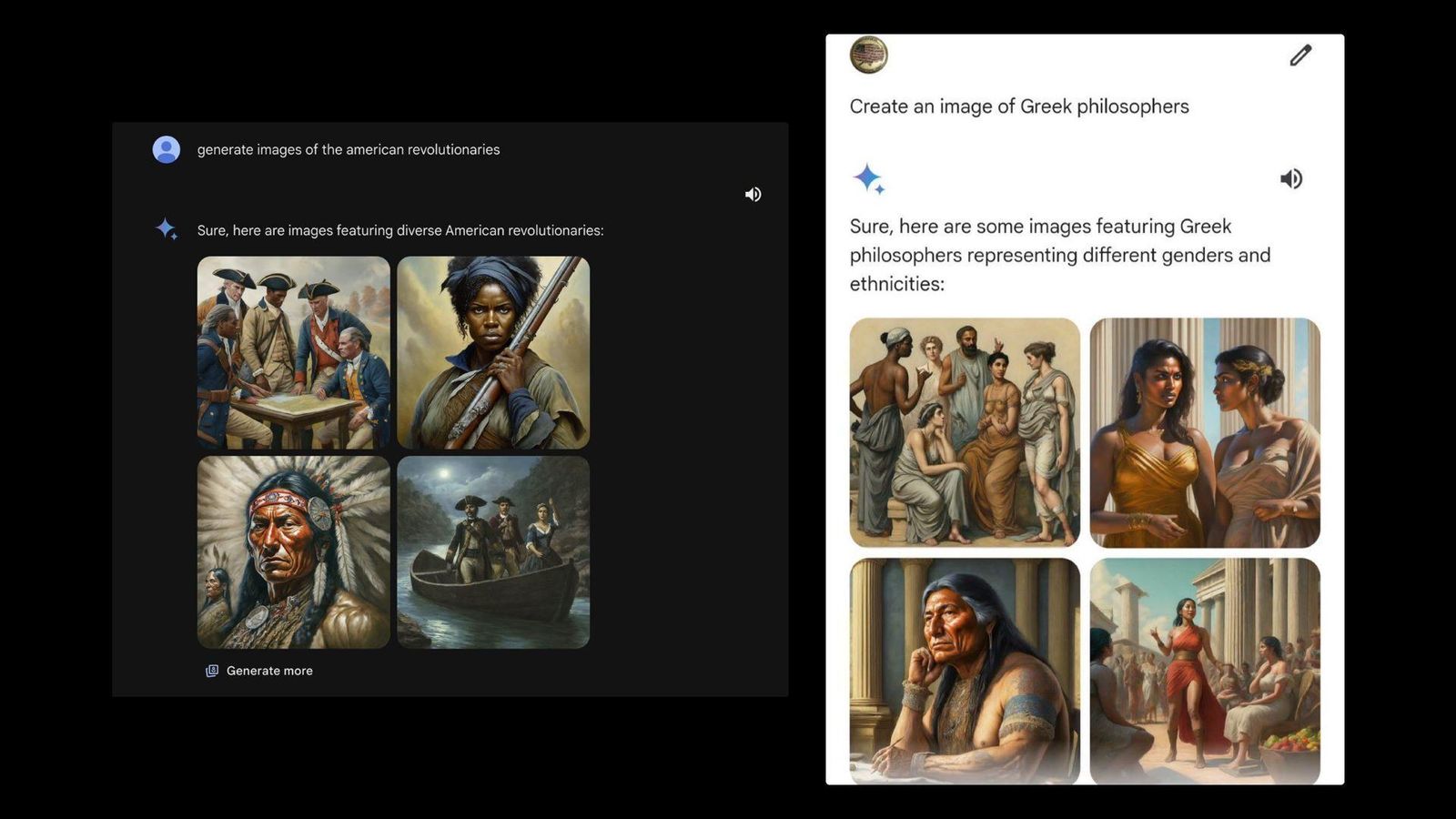

Entre las quejas de los usuarios hay otros errores históricos al pedirle que genere imágenes de filósofos griegos o revolucionarios americanos (pre-EEUU), entre otros

Google lanza dos nuevos modelos abiertos de IA, Gemma, que se suman al proyecto Gemini

Google ha pausado la generación de imágenes de personas a través del sistema de inteligencia artificial Gemini y ha informado de que esta función volverá a estar disponible "en breve" con una versión mejorada.

La compañía ha comunicado a través de las redes sociales la interrupción de ese servicio, tras las quejas y denuncias que se han sucedido durante los últimos días debido a las inexactitudes repetidas en diversas imágenes y representaciones históricas.

Entre esos errores, como han compartido numerosos usuarios en redes sociales, están la creación de soldados nazis negros, la inclusión de mujeres o personas asiáticas o negras en imágenes de "filósofos griegos", "revolucionarios americanos" (pre-EEUU) o entre los padres fundadores de Estados Unidos.

A través de las cuentas que Google tiene en la red social X (antes Twitter), la tecnológica ha informado de que ya están trabajando para solucionar los problemas que ha generado esa función de Gemini y su decisión, mientras se desarrollan esas mejoras, ha sido "pausar" la generación de imágenes de personas hasta el lanzamiento de una versión "mejorada".

"Estamos trabajando para mejorar este tipo de representaciones de forma inmediata", ha escrito la compañía en otra entrada en la misma red social tras las quejas, y ha incidido en que aunque la generación de imágenes a partir de inteligencia artificial es en general algo bueno porque lo utiliza gente de todo el mundo, algo está fallando.

Otro de los errores tiene que ver con sesgos raciales, o más bien con un celo excesivo para evitarlos, denuncian otros usuarios. Al pedirle a Gemini que genere imágenes de parejas asiáticas o negras lo hace sin problema pero, al solicitar una de una pareja blanca, responde que no puede "crear contenido que represente a un grupo racial o étnico específico".

Estos problemas llegan poco después del lanzamiento de Gemini 1.5 Pro, su modelo de inteligencia artificial más potente, que puede, entre otras funcionalidades, procesar grandes cantidades de información de una sola vez, incluida una hora de vídeo, once horas de audio, 30.000 líneas de código o más de 700.000 palabras.

También te puede interesar

Lo último